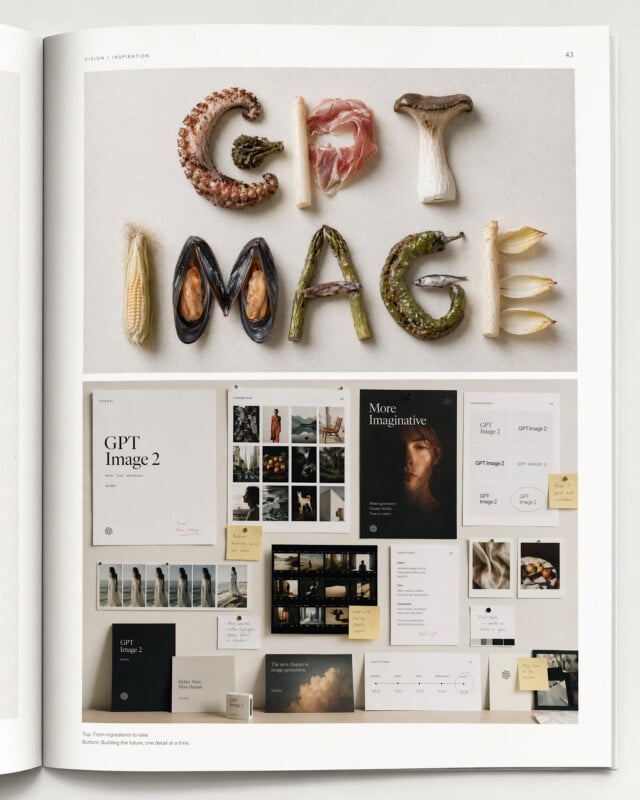

gpt-image-2: El Primer Modelo de Imagen con Razonamiento de OpenAI

gpt-image-2 de OpenAI es el primer modelo de imagen IA que razona antes de dibujar. Lanzado el 21 de abril de 2026 como parte de ChatGPT Images 2.0, combina texto casi perfecto, resolución 2K vía API, salida multilingüe en japonés, coreano, chino, hindi y bengalí, y la capacidad de generar hasta ocho imágenes coherentes desde un solo prompt. Para equipos creativos que llevan tres años peleando con los generadores de IA por la tipografía, los mockups de UI y las infografías, este es el lanzamiento que lleva la generación de imágenes de truco viral a herramienta de producción real.

Dos cosas separan a gpt-image-2 de cualquier modelo anterior. Primero, el nuevo modo Thinking aplica la misma arquitectura de razonamiento que hay detrás de GPT-5 a la generación visual — el modelo planifica composiciones, busca contexto en tiempo real en la web, hace varios borradores y verifica su propio output antes de devolverlo. Segundo, renderiza texto con una precisión cercana al 100% en las pruebas ciegas de LM Arena, entre tres y cinco veces más rápido que Nano Banana Pro de Google.

Aquí está el desglose completo: qué se lanzó, cómo rinde frente a la competencia, cuánto cuesta y cómo usarlo en un workflow creativo esta misma semana.

Qué Es gpt-image-2

gpt-image-2 es el nuevo modelo insignia de generación de imágenes de OpenAI. En ChatGPT se presenta como ChatGPT Images 2.0; en la API y Codex se expone como gpt-image-2 (con chatgpt-image-latest como alias de paridad). El modelo reemplaza a gpt-image-1.5 como default y es el sucesor del motor de imagen de GPT-4o que impulsó las estilizaciones virales tipo Studio Ghibli el año pasado.

Se lanzó el 21 de abril de 2026 en cuatro superficies a la vez:

- ChatGPT (Free, Plus, Pro, Business, Enterprise)

- OpenAI API — model ID

gpt-image-2 - Codex, el entorno de coding de OpenAI

- Microsoft Azure AI Foundry

La generación básica Instant está disponible en todos los planes de ChatGPT incluido el tier gratuito. El modo Thinking avanzado y las funciones de razonamiento multi-imagen están detrás de ChatGPT Plus, Pro y Business.

Dos Modos, Un Solo Modelo

Este es el cambio estructural que la mayoría de análisis pasan por alto. gpt-image-2 corre en dos modos distintos que intercambian latencia por calidad:

| Modo | Velocidad | Salida | Plan | Mejor Para |

|---|---|---|---|---|

| Instant | ~3 segundos | 1 imagen | Free, Plus, Pro, Business | Contenido social, ideación rápida, producción de alto volumen |

| Thinking | 15–60 segundos | Hasta 8 imágenes coherentes | Plus, Pro, Business | Campañas, slides, infografías, tipografía, brand kits |

El modo Instant es el sucesor de la experiencia de imagen de GPT-4o — rápido, barato, bueno. El modo Thinking es el titular: aplica el stack de razonamiento de OpenAI a la generación de imagen por primera vez. Cuando lo activas, el modelo descompone el brief, puede tirar de información actualizada en la web, dibuja composiciones candidatas, se auto-critica y devuelve un set coherente de hasta ocho imágenes desde un solo prompt.

"Las imágenes son un lenguaje, no decoración. Una buena imagen hace lo que hace una buena frase." — OpenAI, anunciando gpt-image-2

Qué Cambió: Las Cinco Cosas Que Importan

1. Renderizado de Texto Casi Perfecto

Durante tres años el texto ha sido el punto débil visible de todos los modelos de imagen IA. Los carteles salían como galimatías. Los logos se convertían en runas. Las etiquetas de un producto acababan como cirílico derretido. gpt-image-2 cierra esa brecha en un solo lanzamiento.

Las pruebas ciegas independientes de LM Arena sitúan la precisión de renderizado de texto cerca del 100% — significativamente por delante de Nano Banana Pro, que ya era el líder en 2025. Los evaluadores señalan que la diferencia entre gpt-image-2 y Nano Banana Pro en tipografía es de un tamaño similar a la que había entre Nano Banana Pro y el DALL·E original.

Qué desbloquea esto en la práctica:

- Slides y decks generados de principio a fin con títulos, bullets y atribuciones reales

- Infografías con números, leyendas y llamadas de atención correctos

- Mockups de UI con etiquetas de botones, menús y navegación reales

- Packaging de producto con ingredientes, paneles nutricionales y códigos de barras legibles

- Gráficos editoriales con titulares, citas destacadas y pies de foto

- Mapas con nombres de lugar legibles y etiquetado cartográfico

Si antes mantenías un modelo IA para la imagen y un paso separado de overlay de texto en Figma o Photoshop, ahora puedes colapsar eso en un único prompt de gpt-image-2 para la mayoría de assets de marketing.

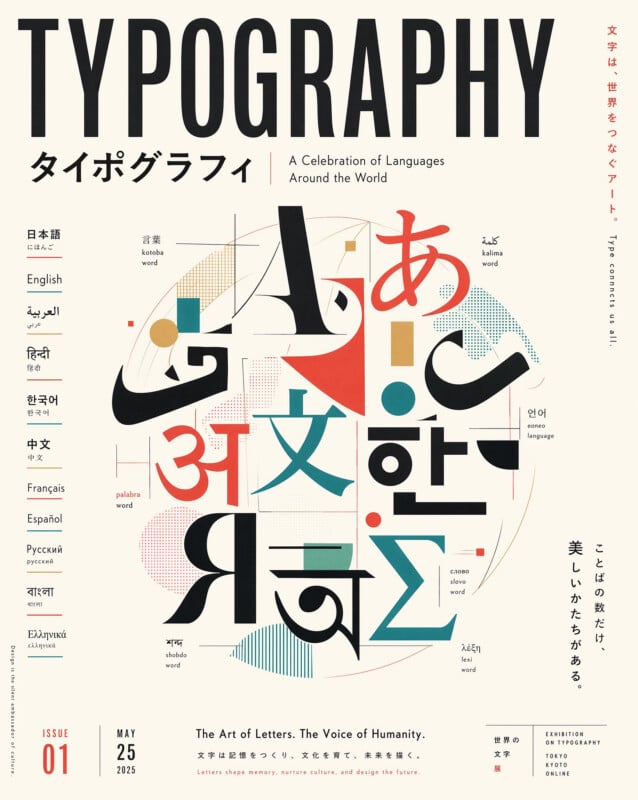

2. Soporte Multilingüe Real

gpt-image-2 amplía de forma significativa el soporte de escritura no latina. OpenAI destacó explícitamente las mejoras en japonés, coreano, chino (simplificado y tradicional), hindi y bengalí. Para marcas globales, este ha sido el mayor bloqueador para usar generación de imágenes IA en mercado — no la creatividad, sino la incapacidad de renderizar una etiqueta de producto en japonés sin que un nativo se riera del resultado.

El modelo ahora maneja layouts densos de scripts mezclados (por ejemplo, una promo de e-commerce con titular en coreano, CTA en inglés y disclaimer en japonés) sin romper la tipografía.

3. Resolución 2K vía API

A través de la API, gpt-image-2 sale hasta 2048×2048 (2K) — frente a los 1024×1024 de la generación anterior. Más importante aún, ahora soporta aspect ratios flexibles desde 3:1 horizontal hasta 1:3 vertical, cubriendo banners, stories de móvil, posters y formatos sociales de forma nativa sin recortes posteriores.

Para equipos creativos esto elimina una de las últimas razones para ir directo a Midjourney o Nano Banana para el hero art: ahora puedes generar assets en resolución final dentro del mismo pipeline que tus llamadas de copy y razonamiento.

4. Hasta Ocho Imágenes Coherentes por Prompt

Esta es la función que realmente cambiará cómo los equipos creativos escriben briefs. En modo Thinking, gpt-image-2 puede devolver hasta ocho imágenes distintas desde un solo prompt — coherentes entre sí en estilo, sujeto y composición, no variaciones aleatorias.

En la práctica eso significa:

- Una hoja de campaña completa (6 tamaños de anuncio) desde un solo brief

- Un storyboard de 6–8 viñetas que mantiene el mismo personaje y la misma iluminación

- Un set de exports adaptados por plataforma (feed, story, thumbnail, carrusel) en una sola pasada

- Un brand kit con variantes de ilustración, patrón y textura coordinadas

"Con la inteligencia de los modelos de razonamiento de OpenAI y una vasta comprensión del mundo visual, este modelo lleva la generación de imagen del renderizado al diseño estratégico." — OpenAI

5. Razonamiento Con Acceso Web en Tiempo Real

Cuando se ejecuta a través de un modelo thinking o Pro, gpt-image-2 puede navegar por la web en vivo durante la generación. Pídele "dibuja los 5 principales lanzamientos de video IA de esta semana como una infografía" y va a tirar de datos reales, diseñar un gráfico coherente y renderizar una pieza citada en una sola petición.

Esta capacidad — generación de imagen anclada en conocimiento — fue pionera con Seedream 5.0 de ByteDance y extendida por Nano Banana Pro con Google Search grounding. gpt-image-2 es el primer modelo de OpenAI que la trae de forma nativa, y se integra de forma más limpia con los workflows de investigación existentes de ChatGPT que cualquiera de los dos competidores.

gpt-image-2 vs Nano Banana Pro vs Seedream 5.0: Comparación Honesta

Aquí es donde la mayoría de posts se convierten en marketing. Esta es la versión que respeta tu tiempo.

| Capacidad | gpt-image-2 | Nano Banana Pro | Seedream 5.0 |

|---|---|---|---|

| Renderizado de texto | Casi 100% (mejor) | Experto | Fuerte |

| Velocidad (Instant) | ~3 segundos | 10–15 segundos | ~7 segundos |

| Resolución máxima | 2K (API) | 4K | 4K |

| Multi-imagen por prompt | Hasta 8 | 1 | 1 |

| Imágenes de referencia | Limitado | 14 (10 objeto + 4 personaje) | 10 |

| Retratos hiperrealistas | Fuerte | Mejor | Fuerte |

| Multilingüe no latino | Mejor | Fuerte (líder chino) | Fuerte |

| Modo Thinking / razonamiento | Nativo | Configurable | Nativo |

| Conocimiento web en tiempo real | Sí | Sí (Google) | Sí |

| Marca de agua SynthID | Opt-in | Sí | No |

| Indemnización de copyright | Estándar | Sí | No |

| Ecosistema | API, Codex, Azure | Photoshop, Figma | ComfyUI, API |

| Precio base API (1K, medio) | ~$0.053 | $0.134 | ~$0.06 |

Cómo leer esta tabla: gpt-image-2 gana donde importan el texto, la velocidad y la producción de campañas en volumen. Nano Banana Pro gana donde importan los retratos con muchas referencias y la postura de riesgo empresarial (marca de agua, indemnización, integración con Creative Cloud). Seedream gana donde importa el precio-por-imagen 4K y las herramientas open.

Para una metodología más profunda sobre cómo se hacen estas comparaciones — y por qué nos negamos a elegir un solo "ganador" — revisa nuestra guía definitiva de los mejores generadores de imagen IA de 2026.

Precios: Lo Que Vas a Pagar De Verdad

A través de la API, gpt-image-2 usa precios por imagen por tramos en resolución 1024×1024:

| Tramo de calidad | Precio por imagen | Uso típico |

|---|---|---|

| Bajo | ~$0.006 | Thumbnails, previews, iteración rápida |

| Medio | ~$0.053 | Posts sociales, gráficos web, marketing estándar |

| Alto | ~$0.211 | Hero art, impresión, finales de campaña |

El precio escala con la resolución y el aspect ratio. En la semana de lanzamiento, algunas cuentas de desarrollador todavía se enrutan por la ruta de facturación de gpt-image-1.5 mientras OpenAI completa el despliegue — los responsables de presupuesto deben verificar la línea exacta tras 48 horas de uso.

Para usuarios de ChatGPT el cálculo es más simple:

- Tier gratuito: modo Instant, límite diario estándar, Images 2.0 incluido

- Plus ($20/mes): Instant + Thinking, límites más altos, sets multi-imagen

- Pro ($200/mes): Thinking en el nivel de razonamiento más alto, uso casi sin tope, cola prioritaria

- Business/Enterprise: controles de admin, SSO, data governance, límites personalizados

A diferencia de Sora, que fue retirado en marzo de 2026 junto con su API, gpt-image-2 salió a través de Codex y Azure AI Foundry desde el día uno. El contraste indica que OpenAI está re-priorizando el acceso programático para imagen frente a video — un pivote relevante para cualquiera que construya sobre su stack.

Qué Significa Esto Para La Guerra De Modelos De Imagen

Hace seis meses, el orden de consenso en el espacio de imagen era: Nano Banana Pro en la cima, Seedream 5.0 justo detrás, Flux para trabajo artístico, Midjourney para estética y GPT Image como el que solo ganaba en texto. Ese orden ya está revuelto.

Tres cambios para interiorizar:

El razonamiento es el nuevo benchmark. Seedream, Nano Banana Pro y gpt-image-2 ahora razonan sobre las composiciones antes de generar. Los modelos de difusión estáticos de una sola pasada se están convirtiendo rápidamente en la gama baja del mercado. Si tu tooling no expone un tier "thinking", tienes tiempo prestado.

El renderizado de texto está resuelto — para los líderes. Lo que antes era un diferenciador ahora es condición mínima. La pregunta interesante ha pasado de "¿puede renderizar texto?" a "¿puede renderizar la tipografía de mi marca, en japonés, en pantalla vertical de móvil, en menos de 10 segundos?". Eso elimina al 60% del mercado de la noche a la mañana.

La velocidad vuelve a estar en juego. El modo Instant de 3 segundos de gpt-image-2 colapsa la brecha de latencia entre "el modelo que uso para idear" y "el modelo que mando a producción". Por primera vez, un solo modelo es lo bastante rápido para whiteboarding y lo bastante bueno para finales.

Para ver cómo encaja esto junto al otro gran cambio de 2026 — modelos con razonamiento nativo como Seedream — revisa nuestro análisis de Seedream 5.0 Lite y el razonamiento visual y el panorama completo de la respuesta de Google con Nano Banana 2.

Un Playbook Práctico: Cómo Usarlo Esta Semana

gpt-image-2 no es un reemplazo drop-in de ningún modelo existente. Es un nuevo default para trabajos concretos. Esta es la asignación a la que la mayoría de equipos creativos van a llegar a finales del Q2 de 2026:

Usa gpt-image-2 (Instant) para

- Posts sociales con copy integrado (evita la ida-y-vuelta a Figma)

- Generación de contenido de slides dentro de Codex / ChatGPT

- Mockups de UI, wireframes y screenshots de dashboards

- Variantes multilingües de campaña donde la tipografía no latina era un bloqueador

- Iteración de alto volumen sobre conceptos antes de comprometerse con un hero

Usa gpt-image-2 (Thinking) para

- Kits de campaña — 6 tamaños de anuncio, 8 exports por plataforma, un solo brief

- Storyboards y frames secuenciales que deben mantener la identidad del personaje

- Infografías donde los datos tienen que estar actualizados y ser correctos

- Brand kits: patrones, texturas, ilustraciones e iconos coordinados

- Cualquier asset que antes requería 3+ rondas de idas y venidas

Quédate con Nano Banana Pro para

- Retratos hiperrealistas y trabajo con likeness de celebridades

- Workflows con muchas referencias (6+ referencias, consistencia de marca sobre 14 assets)

- Todo lo que vaya a industrias reguladas que exigen indemnización

- Integraciones nativas con Photoshop y Figma

Quédate con Seedream para

- Exports 4K finales con precio-por-imagen agresivo

- Pipelines de ComfyUI y tooling open

- Campañas primero-para-mercado-chino

Mantén un modelo artístico dedicado (Midjourney / Flux) para

- Ilustración editorial y trabajo de mood

- Iluminación cinematográfica y estética pictórica

- Todo donde "incorrecto pero bonito" le gana a "correcto pero literal"

No consolides en un único modelo de imagen. Cada equipo que hemos visto estandarizar sobre un solo proveedor ha reconstruido un workflow multi-modelo en 90 días. La frontera de economía y calidad se mueve demasiado rápido — mensualmente, no anualmente.

Cómo Acceder a gpt-image-2

gpt-image-2 está en vivo en cinco superficies hoy:

- ChatGPT (web, desktop, móvil) — modo Instant para todos; modo Thinking en Plus/Pro/Business

- API de OpenAI — model ID

gpt-image-2(ochatgpt-image-latestpara paridad con ChatGPT) - Codex — integración nativa dentro del entorno de coding de OpenAI

- Microsoft Azure AI Foundry — enrutamiento enterprise con tu contrato de Microsoft

- XainFlow — disponible en Flow Studio junto con Nano Banana 2, Seedream 5.0 Lite, Recraft v3, Flux y otros

Quick Start (API)

from openai import OpenAI

client = OpenAI()

response = client.images.generate(

model="gpt-image-2",

prompt="A minimalist SaaS dashboard mockup, blue accent, clean sans-serif labels reading 'Revenue', 'Active Users', 'Churn'",

size="1024x1024",

quality="medium",

n=1

)

Para modo Thinking y sets multi-imagen, enruta a través de la Responses API con reasoning: { effort: "high" } y n hasta 8. Los endpoints de imagen de OpenAI requieren una verificación única de API Organization en la mayoría de cuentas — complétala primero o tus llamadas caerán silenciosamente a gpt-image-1.5.

Úsalo Dentro de XainFlow

Dentro de Flow Studio de XainFlow, gpt-image-2 se enchufa en cualquier nodo de workflow como fuente de imagen. Un pipeline multi-modelo típico se ve así:

- Nodo de research — Claude o GPT-5 recoge el brief + las referencias

- gpt-image-2 (Thinking) — genera 6 variantes coherentes de campaña

- Nano Banana Pro — regenera el hero shot con consistencia de 14 referencias

- Upscale + Background Remover — finaliza los entregables

- Biblioteca de assets — publica al proyecto, etiquetado con variables de marca

Esa es la diferencia entre "hoy usé un modelo de imagen" y "mi equipo sacó una campaña de 40 assets antes de comer".

La Conclusión

gpt-image-2 es el lanzamiento de modelo de imagen más importante de 2026 hasta ahora, porque hace tres cosas que ningún modelo anterior hacía a la vez: razona, escribe texto con precisión y a velocidad, y devuelve sets multi-imagen coherentes desde un solo prompt. Por separado, cada capacidad existía en otros sitios. Juntas, comprimen un workflow creativo que antes abarcaba cinco herramientas y tres rondas en una sola llamada.

No es el final de Nano Banana Pro, Seedream, Flux ni Midjourney. Es el final de la era en la que podías apañarte con un solo modelo de imagen. Los mejores equipos creativos de los próximos 12 meses serán los que orquesten cuatro o cinco — y eso es exactamente para lo que están construidas las plataformas modernas de workflows de IA.

XainFlow ejecuta gpt-image-2 junto con Nano Banana 2, Seedream 5.0 Lite, Recraft v3, Flux y un stack completo de modelos de video en un solo workspace. Construye un pipeline multi-modelo una vez, ejecútalo las veces que tu equipo entregue. Explora Flow Studio →

Preguntas Frecuentes

¿Qué es gpt-image-2?

gpt-image-2 es el nuevo modelo insignia de generación de imágenes de OpenAI, lanzado el 21 de abril de 2026 como parte de ChatGPT Images 2.0. Es el primer modelo de imagen que integra capacidades de razonamiento — un modo 'Thinking' donde el modelo planifica y verifica la imagen antes de finalizar la salida — junto con texto casi perfecto, resolución 2K vía API, soporte multilingüe para japonés, coreano, chino, hindi y bengalí, y la capacidad de generar hasta ocho imágenes coherentes a partir de un solo prompt.

¿Es gpt-image-2 mejor que Nano Banana Pro?

Depende de la tarea. En pruebas ciegas independientes de LM Arena, gpt-image-2 supera a Nano Banana Pro en renderizado de texto (precisión cercana al 100%), UI, conocimiento del mundo y velocidad (~3 segundos frente a 10–15 segundos). Nano Banana Pro sigue ganando en consistencia multi-referencia con hasta 14 imágenes, retratos hiperrealistas, integración con Photoshop/Figma, marca de agua SynthID e indemnización de derechos de autor. Para diseños con mucho texto, mockups de UI y slides, usa gpt-image-2. Para retratos y composiciones con muchas referencias, Nano Banana Pro sigue siendo mejor opción.

¿Cuánto cuesta gpt-image-2?

gpt-image-2 usa precios por imagen por tramos en 1024×1024: aproximadamente $0.006 (calidad baja), $0.053 (calidad media) y $0.211 (calidad alta). El modo Instant está incluido para todos los usuarios de ChatGPT — incluido el tier gratis — y para los usuarios de Codex. El modo Thinking avanzado y las funciones de razonamiento multi-imagen están restringidos a suscriptores Plus, Pro y Business. La API también se está desplegando a través de Microsoft Azure AI Foundry.

¿Cuál es la diferencia entre el modo Instant y Thinking?

El modo Instant produce imágenes en unos 3 segundos usando el modelo base — ideal para ideación rápida, contenido social y producción de alto volumen. El modo Thinking, disponible en planes Plus/Pro/Business, ejecuta gpt-image-2 a través de un bucle de razonamiento extendido: el modelo analiza el brief, puede buscar información en tiempo real en la web, genera múltiples composiciones candidatas, verifica su propia salida y devuelve hasta 8 variantes coherentes desde un solo prompt. Usa Thinking para kits de campaña, slides, infografías y diseños con mucha tipografía.

¿Puedo usar gpt-image-2 en XainFlow?

Sí. XainFlow ya soporta la familia gpt-image de OpenAI junto con Nano Banana 2 (gemini-3.1-flash-image-preview), Seedream 5.0 Lite, Recraft v3, variantes de Flux y más. Dentro de Flow Studio puedes construir workflows multi-modelo — por ejemplo, usar gpt-image-2 para assets hero con mucho texto, Nano Banana Pro para producto hiperrealista y Seedream para composiciones con datos actualizados, todo en un solo pipeline.